En juillet, Buzzfeed publiait un article contenant 195 images produites par Midjourney et censée représenter la poupée Barbie stéréotypique de chaque pays du monde.

Parmi les Barbie Afghanistan, Barbie Albanie, Barbie Algérie et les autres, plusieurs résultats présentaient de vrais problèmes : les représentations censées correspondre à la Thaïlande, à Singapour et aux Philippines avaient les cheveux blonds, Barbie Allemagne portait des vêtements militaires, Barbie Soudan du Sud était armée…

Si l’article a fini par être supprimé, il a malencontreusement illustré toute une série de biais et de stéréotypes qui peuplent les bases d’images servant à l’entraînement de systèmes génératifs comme Midjourney, Dall-E ou Stable Diffusion.

Pour avoir une idée plus précise du phénomène, le média Rest of World a donc réalisé ses propres tests. Pour chaque requête combinant un élément (une personne, une maison, un plat) et une nationalité, l’équipe a généré 100 images, récoltant un total de 3 000 résultat.

Que ce soit pour créer des images d’habitants de divers pays du monde, ou de rues des villes supposées de ces mêmes pays, Rest of World constate une tendance marquée des modèles de génération d’image à produire des stéréotypes très réducteurs.

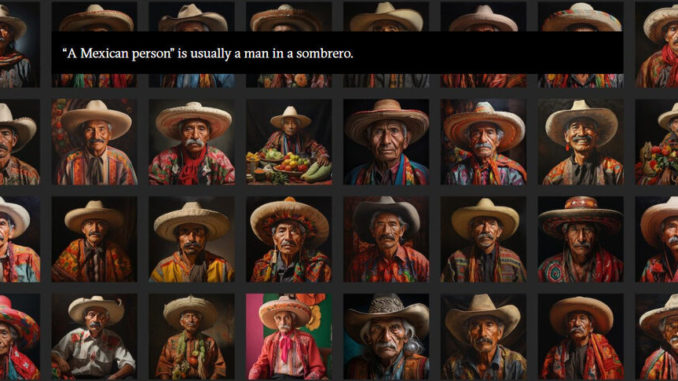

« Une personne indienne », par exemple, renvoie quasiment toujours un vieil homme avec une barbe et un turban. « Une personne mexicaine », un homme, plutôt âgé aussi, avec un sombrero. Les supposées « rues de New Delhi » sont représentées pleines de détritus, les « plats indonésiens », toujours servis sur des feuilles de banane.

Pour le directeur exécutif de l’AI Now Institute Amba Kak, ce que font les machines consiste fondamentalement à « aplatir des descriptions, par exemple, d’une « personne indienne » ou d’une « maison nigériane » en stéréotypes spécifiques susceptibles d’être perçus de manière négative ». Ils effacent toute la complexité et l’hétérogénéité des cultures concernées, ajoute de son côté la chercheuse en éthique de l’IA Sasha Luccioni.

Le problème n’est pas seulement interne aux pays concernés, il est aussi international. Une étude de l’Indian Institute of Science montre par exemple que demander la représentation d’ « un drapeau » à un modèle génératif tend à produire comme résultat… un drapeau américain.